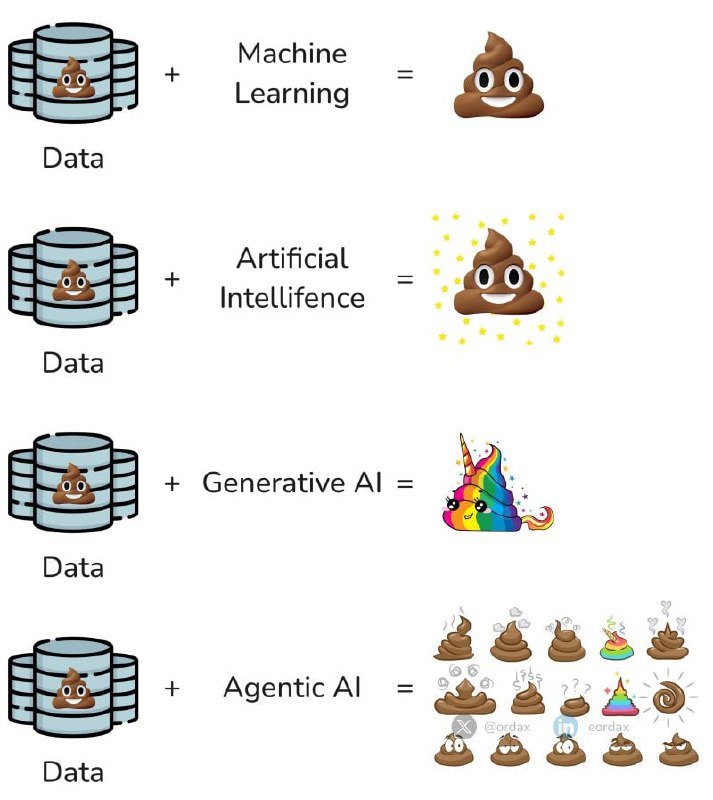

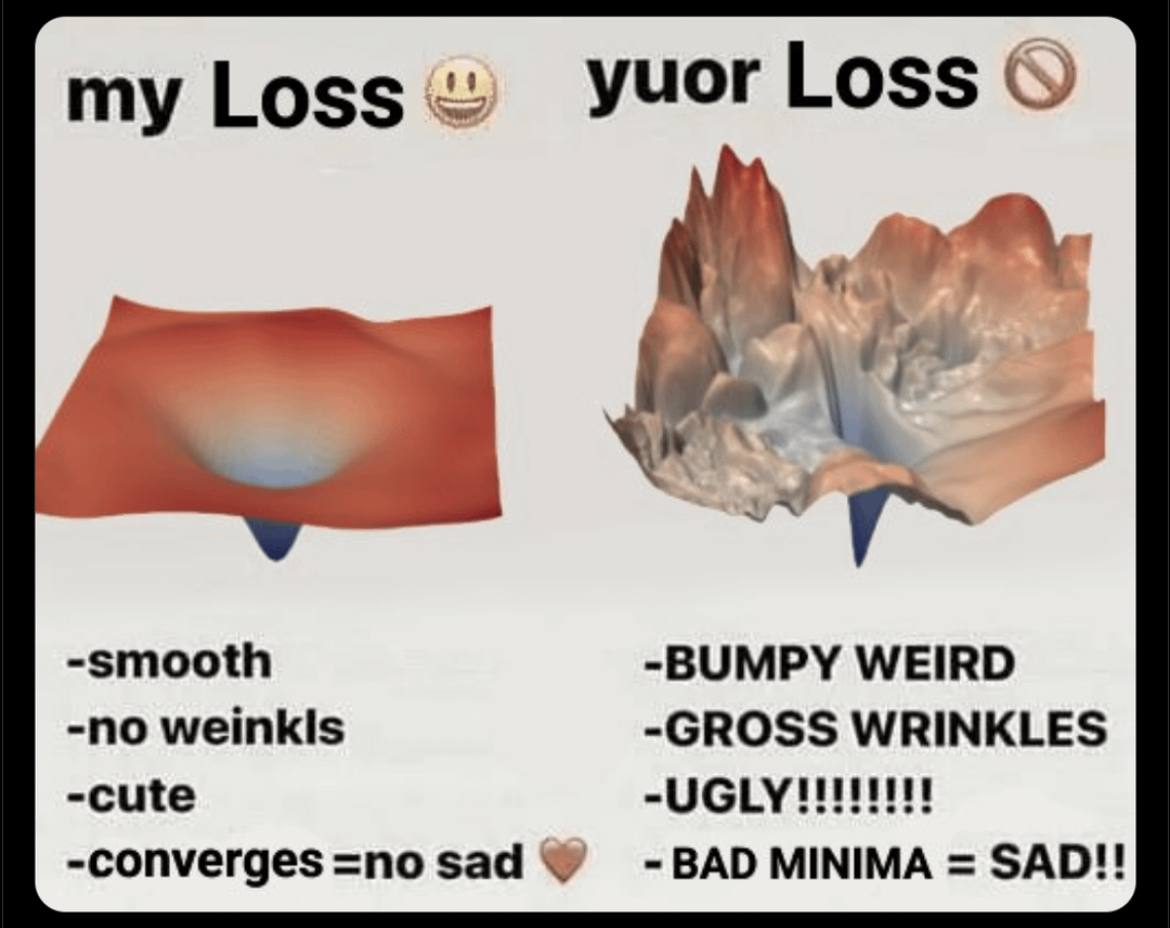

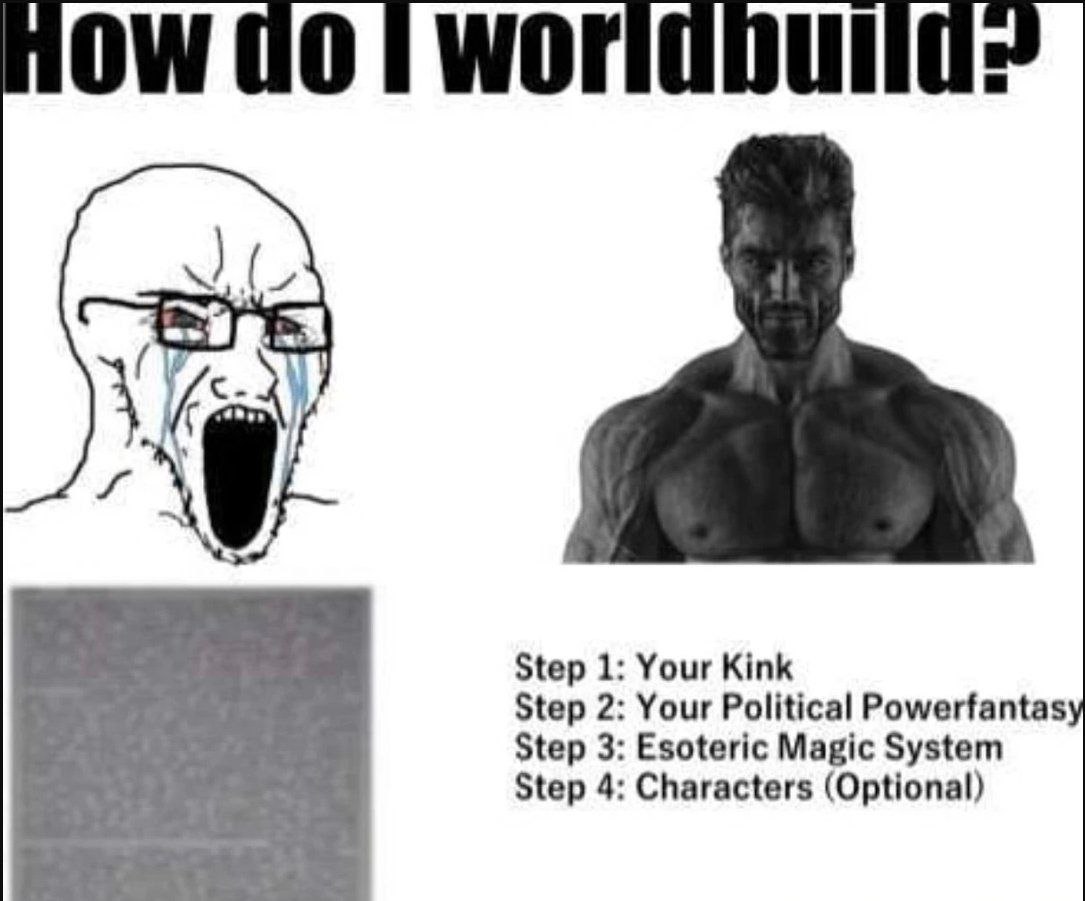

Statistical learning vs Neural networks

На изображении показано сравнение двух подходов в машинном обучении: статистического обучения и нейронных сетей. В верхней части картинки нарисован человечек, который, с очень сердитым лицом, выступает перед аудиторией, указывая на доску с графиком, где красная линия идёт вниз. Он произносит длинную и сложную речь о проблемах переобучения и необходимости пересмотра модели. В нижней части изображения нарисован другой человечек, который выглядит более расслабленным, указывает на доску с графиком, где зелёная линия идёт вверх, и говорит "STACK MORE LAYERS". Этот мем высмеивает сложность традиционных методов машинного обучения по сравнению с более простым, но часто эффективным подходом нейронных сетей: просто добавить больше слоёв. Другими словами, пока в статистическом обучении есть очень много сложных "Gentlemen, our learner overgeneralizes because the VC-Dimension of our Kernel is too high, Get some experts and minimze the structural risk in a new one. Rework our loss function, make the next kernel stable, unbiased and consider using a soft margin" ("Господа, наш учащийся слишком обобщает, потому что VC-размерность нашего ядра слишком высока. Пригласите экспертов и минимизируйте структурный риск в новом. Переработайте нашу функцию потерь, сделайте следующее ядро стабильным, несмещенным и рассмотрите возможность использования мягкого поля"), в нейронных сетях решение куда проще: "STACK MORE LAYERS" ("Наложите больше слоев").

Statistical learning. Gentlemen, our learner overgeneralizes because the VC-Dimension of our Kernel is too high, Get some experts and minimze the structural risk in a neW one. Rework our loss function, make the next kernel stable, unbiased and consider using a soft margin. Neural networks. Stack more layers. Layers. Layers.